H800和A100在计算任务上有什么区别?

发布日期:

2025-04-01 13:29:09

本文链接

https://www.idcsp.com//help/2501.html

本文关键词

H800 和 A100 在计算任务上的区别主要体现在以下几个方面:

1. 架构与计算能力

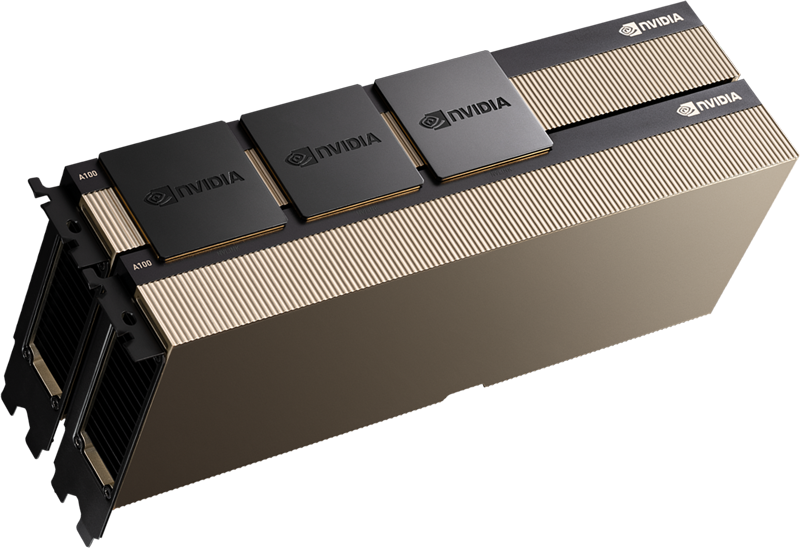

A100:采用 Ampere 架构,拥有 6912 个 CUDA 核心,支持第三代 Tensor Core。其 FP64 双精度性能为 19.5 TFLOPS,FP32 单精度性能为 312 TFLOPS。

H800:基于 Hopper 架构,采用 4nm 工艺,拥有 14,592 个 CUDA 核心。其 FP64 双精度性能为 1 TFLOPS,FP32 单精度性能为 67 TFLOPS。虽然双精度性能较低,但其在单精度和混合精度计算上表现更强。

2. 显存与带宽

A100:配备 80GB HBM2 显存,显存带宽为 2TB/s。

H800:配备 24GB GDDR6 显存,显存带宽为 696 GB/s。虽然显存容量较小,但带宽较高,适合快速数据传输。

3. Tensor Core 性能

A100:支持 FP32 和 FP16 精度的 Tensor Core,性能在混合精度计算中表现良好。

H800:引入了第四代 Tensor Core 和 FP8 数据格式,支持 E4M3 和 E5M2 两种精度。其 FP8 Tensor Core 性能高达 3958 TFLOPS,在 AI 训练和推理任务中性能显著提升。

4. 多实例 GPU(MIG)

A100:支持多实例 GPU 技术,可将 GPU 划分为多个独立实例,每个实例可独立分配显存和计算资源。

H800:采用第二代多实例 GPU 技术,支持更高性能的多租户配置。

5. 互连技术

A100:支持 NVLink 互连技术,带宽可达 600GB/s。

H800:支持 NVLink 互连速度可达 400GB/s,虽然带宽较低,但仍然能够满足大多数计算任务的需求。

6. 应用场景

A100:适合数据中心、高性能计算(HPC)和深度学习任务,尤其在需要大量计算资源的企业级应用中表现良好。

H800:更适合 AI 大模型训练和推理任务,尤其是在需要高带宽和高吞吐量的场景中。

总结

如果你的计算任务主要涉及大规模 AI 模型训练和推理,且对显存带宽和 Tensor Core 性能要求较高,H800 是更好的选择。

如果你的任务更偏向于传统的高性能计算(HPC)或需要较大的显存容量,A100 可能更适合。

成都算力租赁入口:https://www.idcsp.com/gpu/

成都算力租赁官方电话:400-028-0032

优选机房

注册有礼

注册有礼

在线咨询

在线咨询

咨询热线:400-028-0032

咨询热线:400-028-0032