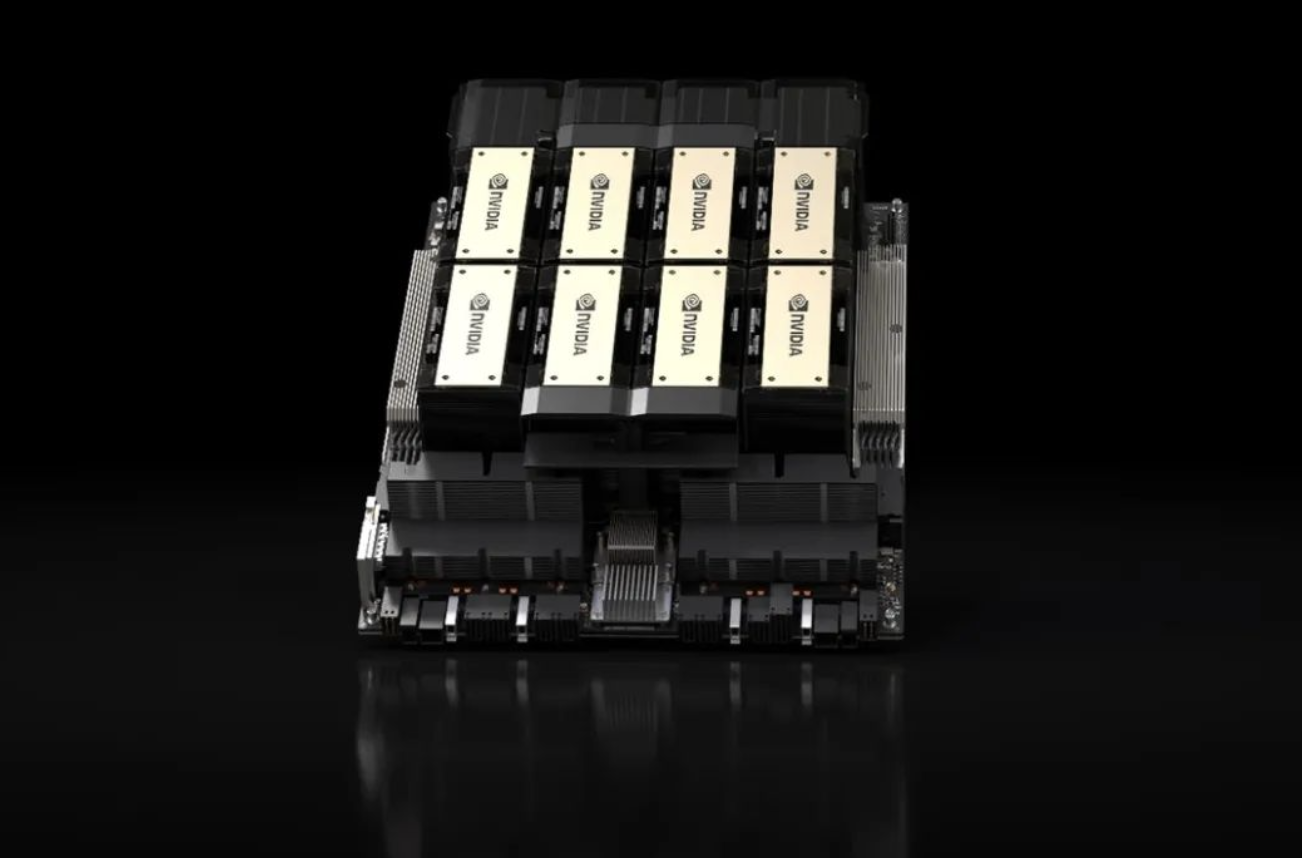

H20 vs RTX 4090,谁才是你的真命天卡?

发布日期:

2025-03-04 17:47:28

本文链接

https://www.idcsp.com//industry/2397.html

本文关键词

在AI推理任务中,H20和RTX 4090是两种不同定位的硬件,它们的性能表现和应用场景各有优劣。以下是它们的性能对比和分析:

1.硬件规格对比

2. 性能对比

(1)显存与带宽

H20:通常配备HBM显存,容量大(48GB或更高),带宽极高,适合处理超大规模模型和数据密集型任务。

RTX 4090:配备24GB GDDR6X显存,带宽较高,但在处理超大模型时可能显存不足。

结论:H20在显存容量和带宽上更具优势,适合超大规模AI推理任务。

(2)计算性能

H20:专为AI和高性能计算优化,支持FP16/BF16/TF32等低精度计算,适合大规模并行计算。

RTX 4090:虽然计算性能强大,但更偏向通用计算和图形处理,在AI推理任务中表现优异,但在超大规模任务中可能不如H20。

结论:H20在AI推理任务中的计算效率更高,尤其是在低精度计算和大规模并行任务中。

(3)延迟与吞吐量

H20:针对数据中心优化,延迟低,吞吐量高,适合高并发推理任务。

RTX 4090:延迟较低,吞吐量较高,但在高并发场景下可能不如H20稳定。

结论:H20在高并发、低延迟的推理任务中表现更优。

(4)软件生态

H20:支持NVIDIA的AI企业级软件栈(如TensorRT、Triton Inference Server),专为AI推理优化。

RTX 4090:支持主流AI框架(如TensorFlow、PyTorch),但在企业级优化方面不如H20。

结论:H20在软件生态和优化方面更具优势。

3. 适用场景对比

4. 性价比分析

H20:价格昂贵,适合企业级用户和大规模AI推理任务,性价比在超大规模场景中较高。

RTX 4090:价格相对较低,适合中小规模推理任务和消费级用户,性价比在小规模场景中较高。

H20在超大规模AI推理任务中表现更优,适合企业级用户和高并发场景,但价格较高;RTX 4090在中小规模AI推理任务中性价比更高,适合消费级用户和实验性部署。

所以,如果你的任务是超大规模AI推理或高并发场景,H20是更好的选择;如果是中小规模任务或预算有限,RTX 4090则更具性价比。

无论是H20还是4090,想要满足需求,节约成本,都可以选择在极云进行算力租用,点击下方链接,极云科技为您解决算力焦虑~

近期更有免费试用等你体验!

优选机房

注册有礼

注册有礼

在线咨询

在线咨询

咨询热线:400-028-0032

咨询热线:400-028-0032